Nagios, Icinga & Co.

Ein Leitfaden zur Überwachung der IT-Infrastruktur mit Open-Source-Tools

Im Rahmen von DevOps-Initiativen, Digitalisierungsprojekten und Cloud-Migrationen investieren viele Kunden in Application Performance Management (APM).

Ziel sind höhere Kundenzufriedenheit und damit verbundene Umsatzsteigerungen, was durch schnellere Release-Zyklen und die dadurch reduzierte Time-to-Market bei verbesserter Software- Qualität erreicht werden kann.

Häufig wird angenommen und auch von den Herstellern der APM-Lösungen suggeriert, dass dies bereits mit der Anschaffung des neuen Tools erreicht werden kann. Wie unsere Erfahrungen jedoch zeigen, ist dies kein realistischer Ansatz. Der Mehrwert von APM kann nur dann voll zum Tragen kommen und ein ROI erreicht werden, wenn die nötigen Prozesse für eine konstante Aktualisierung und Verbesserung des APM-Prozesses etabliert und im Unternehmen verankert werden.

Lösungen zur Überwachung der IT-Infrastruktur - Herausforderungen und Auswahl

"Kein funktionierendes Business ohne funktionierende IT" - auf diesen einfachen Nenner lässt sich die aktuelle Situation in den meisten Unternehmen bringen. Die Grundlage für den erfolgreichen Betrieb einer immer komplexer werdenden IT-Umgebung ist heute mehr denn je, wie gut die IT in der Lage ist, sich kontinuierlich einen möglichst umfassenden Überblick über den aktuellen Zustand des IT-Systems zu verschaffen und Probleme und Vorfälle zu erkennen, bevor sie das Nutzererlebnis beeinträchtigen oder zu einem Ausfall führen.

Im Mittelpunkt steht dabei die IT-Infrastruktur, das Rückgrat der IT, auf dem alle anderen IT-Prozesse laufen - und von dessen Ausfall auch alle darauf aufbauenden IT-Prozesse betroffen sind. Dieser Leitfaden befasst sich mit zwei zentralen Fragen zum IT-Infrastruktur-Monitoring:

1. Wie kann eine erfolgreiche Überwachung in modernen, heterogenen und komplexen IT-Infrastrukturen erreicht werden?

2. Welche Unterstützung bieten Open-Source-Tools wie Nagios oder Icinga?

IT-Infrastrukturüberwachung: Bedeutung für den Betrieb moderner IT-Umgebungen

Je größer die Bedeutung moderner IT-Infrastrukturen für den reibungslosen Ablauf von Unternehmensprozessen und das Kundenerlebnis, desto wichtiger ist eine effiziente IT-Infrastrukturüberwachung.

Die Gründe liegen auf der Hand:

Optimierung der IT-Leistung: Mit der zunehmenden Bedeutung moderner IT-Infrastrukturen für den Unternehmenserfolg steigen auch die Herausforderungen an die IT-Performance. Professionelles IT-Infrastruktur-Monitoring liefert kontinuierlich und in Echtzeit wichtige Einblicke in die Leistung des IT-Systems und zeigt Bereiche und Möglichkeiten auf, wo und wie diese Leistung optimiert werden kann. Durch die Überwachung wichtiger KPIs wie CPU-Auslastung, Speichernutzung, Netzwerkverkehr und Antwortzeiten ist die IT in der Lage, Optimierungspotenzial zu identifizieren oder die Konfiguration anzupassen, um die Leistung des Gesamtsystems zu steigern.

Proaktive Erkennung von Problemen: Die Überwachung der IT-Infrastruktur ermöglicht es Unternehmen, Schwachstellen und potenzielle Probleme zu erkennen, bevor sie kritische Systeme oder Dienste beeinträchtigen. Durch die Überwachung verschiedener IT-Komponenten wie Server, Netze, Anwendungen und Datenbanken können IT-Leistungsengpässe, Sicherheitsschwachstellen oder Hardwareausfälle frühzeitig erkannt und proaktiv Abhilfemaßnahmen ergriffen werden.

Fehlersuche und Problemlösung: Wenn in der IT-Infrastruktur Probleme oder Zwischenfälle auftreten, liefert die IT-Infrastrukturüberwachung wertvolle Informationen, um so schnell wie möglich wieder "online" zu gehen. Es hilft dabei, den Umfang und die Auswirkungen eines Vorfalls zu bestimmen, die betroffenen Komponenten zu lokalisieren und relevante Daten für die Analyse zu sammeln. Dies ist entscheidend für die Ursachenanalyse und ermöglicht es der IT-Abteilung, die zugrunde liegenden Probleme zu beheben und ähnliche Vorfälle in Zukunft zu verhindern.

Kapazitätsplanung und Skalierbarkeit: Daten aus dem IT-Infrastruktur-Monitoring bilden die Grundlage für die Prognose der weiteren Entwicklung der Ressourcennutzung und damit des zukünftigen Ressourcenbedarfs. KPIs wie Speichernutzung, Netzwerkbandbreite und Systemlasten helfen der IT zu erkennen, wann zusätzliche Ressourcen benötigt werden. Auf diese Weise werden Leistungseinbußen durch Ressourcenengpässe vermieden. So wird sichergestellt, dass die IT-Infrastruktur auch in Zukunft dem Wachstum des Unternehmens gerecht wird.

Sicherheit und Konformität: In Zeiten rasant wachsender Bedrohungen durch Cyberangriffe spielt die professionelle Überwachung der IT-Infrastruktur eine wichtige Rolle, um diese Angriffe und Bedrohungen so früh wie möglich zu erkennen und abzuwehren. Die Überwachung von Netzwerkprotokollen, Netzwerkverkehr und Systemverhalten deckt potenzielle Sicherheitslücken, anomale Aktivitäten oder unberechtigte Zugriffsversuche auf. Dies ermöglicht es der IT-Abteilung, sofortige Gegenmaßnahmen zu ergreifen, Risiken zu mindern und die Einhaltung von Compliance- und Datenschutzvorschriften zu gewährleisten.

Die wichtigsten Anforderungen an eine moderne IT-Infrastrukturüberwachung

Dies wirft die Frage auf, welche Anforderungen ein modernes IT-Infrastruktur-Monitoring erfüllen muss, um auch komplexe IT-Umgebungen überwachen zu können.

Umfassende Abdeckung von Systemen, Technologien und Plattformen: Die Überwachungslösung sollte ein breites Spektrum von IT-Infrastrukturkomponenten abdecken: Server, Netzwerke, Speichersysteme, Virtualisierungsplattformen, Datenbanken, Anwendungen, Cloud-Dienste usw. - Je heterogener und hybrider (Kombination aus On-Premise-Betrieb und Cloud-Nutzung) die IT-Umgebung ist, desto wichtiger ist es, dass die Monitoring-Lösung möglichst viele Betriebssysteme und Technologieplattformen (z. B. die großen Hyperscaler-Cloud-Plattformen) unterstützt.

Überwachung und Warnmeldungen in Echtzeit: Die Monitoring-Lösung sollte Echtzeit-Überwachungs- und Alarmfunktionen bieten, um KPIs möglichst schnell, aber auch kontinuierlich zu erfassen und zu analysieren. Werden vordefinierte Schwellenwerte überschritten oder Anomalien festgestellt, muss die zuständige IT-Abteilung sofort benachrichtigt werden, damit sie zeitnah reagieren und drohende Ausfallzeiten minimieren kann.

Zentralisierte Verwaltung und Visualisierung: Eine zentralisierte Verwaltungskonsole ist besonders wichtig für die Überwachung großer und verteilter IT-Umgebungen. Die Lösung muss in der Lage sein, auf Knopfdruck einen konsolidierten Überblick über die gesamte IT-Infrastruktur zu geben. Die IT-Abteilung kann damit auf Echtzeit- und historische Überwachungsdaten zugreifen, Überwachungseinstellungen konfigurieren und Warnungen verwalten. Intuitive Visualisierungs- und Berichtsfunktionen sind ebenfalls wichtig, um die Datenanalyse und Entscheidungsfindung zu erleichtern.

Skalierbarkeit und Flexibilität: Da moderne IT-Umgebungen in der Regel kontinuierlich wachsen und sich weiterentwickeln, sollte die Überwachungslösung ein hohes Maß an Skalierbarkeit aufweisen, um wachsende Datenmengen und neue Infrastrukturkomponenten verarbeiten zu können. Außerdem sollte die Lösung flexibel genug sein, um sich an veränderte Geschäftsanforderungen anzupassen und zukünftige technologische Entwicklungen zu berücksichtigen.

Integration und APIs: Integrationsfunktionen sind für die nahtlose Integration mit anderen IT-Verwaltungstools und -systemen wie IT-Ticket-Systemen, Service-Desk-Plattformen oder IT-Betriebsmanagement-Frameworks unerlässlich. Die Überwachungslösung sollte APIs bereitstellen und gängige Protokolle unterstützen, um den Datenaustausch und die Integration mit Tools von Drittanbietern zu ermöglichen und so die Automatisierung und Optimierung von Arbeitsabläufen zu erleichtern.

Automatisierung und intelligente Analytik: Künstliche Intelligenz spielt auch bei der Überwachung der IT-Infrastruktur eine immer wichtigere Rolle. Moderne Überwachungslösungen nutzen Automatisierung und intelligente Analysefunktionen wie maschinelles Lernen und andere KI-Technologien, um Muster zu erkennen, Anomalien zu entdecken und potenzielle Probleme vorherzusagen. Diese Funktionen unterstützen die IT dabei, Probleme proaktiv anzugehen, Routineaufgaben zu automatisieren und so die Leistung des Gesamtsystems zu optimieren.

Nagios und Icinga: Open-Source-Tools für die Überwachung der IT-Infrastruktur

Wie auch in anderen Bereichen der Software-Nutzung haben sich Open-Source-Lösungen wie Nagios oder Icinga in der IT-Infrastrukturüberwachung fest etabliert. Allgemein werden folgende Argumente für den Einsatz einer Open-Source-IT-Infrastrukturüberwachungslösung angeführt.

Kosten: Open-Source-Tools werden in der Regel kostenlos angeboten. Anstatt Geld für den Kauf kommerzieller Lösungen auszugeben, können Unternehmen dieses Budget für andere wichtige Bereiche verwenden.

Anpassungsfähigkeit: Open-Source-Tools bieten die Freiheit, die Überwachungslösung an unternehmensspezifische Anforderungen anzupassen. Zu diesem Zweck kann sogar der Quellcode der Lösung geändert werden. Diese Flexibilität ist bei kommerziellen Lösungen in der Regel nicht gegeben.

Unabhängigkeit des Anbieters: Durch den Einsatz von Open-Source-Tools sind Unternehmen nicht an einen bestimmten Anbieter oder Technologie-Stack gebunden. Sie haben die Freiheit, zwischen verschiedenen Tools und Plattformen zu wählen und zu wechseln, ohne in proprietäre Ökosysteme eingebunden zu sein. Eine Bindung an einen bestimmten Anbieter ist daher von vornherein ausgeschlossen.

Unterstützung durch die Gemeinschaft: Open-Source-Tools haben in der Regel eine aktive Gemeinschaft von Entwicklern und Nutzern, die zu ihrer Optimierung und Weiterentwicklung beitragen und Support leisten. Der einzelne Nutzer profitiert von einer Fülle von Wissen, Foren, Dokumentationen sowie Updates und Add-ons, die von der Community bereitgestellt werden.

Nagios: die wichtigsten Funktionen

Nagios ist ein beliebtes Open-Source-Tool für die Überwachung von IT-Infrastrukturen. Die Lösung ermöglicht die Überwachung einer breiten Palette von Infrastrukturkomponenten wie Servern, Switches, Routern, Anwendungen, Diensten und Netzwerkprotokollen. Nagios unterstützt sowohl aktive als auch passive Kontrollen und sammelt Überwachungsdaten in Echtzeit.

Um rechtzeitig benachrichtigt zu werden, kann der Nagios-Benutzer Schwellenwerte und Bedingungen definieren, bei denen ein Alarm ausgelöst wird. Benachrichtigungen können über eine Vielzahl von Kanälen wie E-Mail, SMS oder benutzerdefinierte Skripte versendet werden, um sicherzustellen, dass die richtige Person sofort informiert wird, wenn Vorfälle auftreten. Darüber hinaus enthält das System einen Mechanismus zur Ereignisbehandlung, der automatisch vordefinierte Aktionen oder Skripte ausführt, wenn ein Problem auftritt. Eine Eskalationsfunktion sorgt dafür, dass kritische Meldungen an eine geeignete Stelle weitergeleitet werden, wenn auf die ursprüngliche Meldung nicht reagiert wurde.

Nagios verfügt über eine zentrale webbasierte Benutzeroberfläche, die einen vollständigen Überblick über die gesamte Überwachungsumgebung bietet. Die Benutzer können auch die entsprechenden Überwachungseinstellungen vornehmen, Statusinformationen abrufen, Alarme bestätigen und andere administrative Aufgaben durchführen. Die Integration in verschiedene externe Tools und Anwendungen wie IT-Ticket-Systeme, IT-Service-Management (ITSM ) und Reporting-Tools ist ebenfalls möglich.

Nagios hat eine sehr große und aktive Gemeinschaft von Anwendern und Entwicklern, die zur kontinuierlichen Weiterentwicklung und Unterstützung des Tools beitragen. Dieses Community-getriebene Ökosystem sorgt dafür, dass Nagios mit neuen Funktionen, Bugfixes und der Verfügbarkeit von Plugins auf dem neuesten Stand bleibt.

Icinga

Ein weiteres Open-Source-Tool für die Überwachung der IT-Infrastruktur ist Icinga. Icinga wurde ursprünglich als eine Abspaltung von Nagios entwickelt. Ziel der Entwickler war es, Defizite im Entwicklungsprozess von Nagios zu beheben und bestehende Einschränkungen von Nagios zu beseitigen. Dies gilt insbesondere für das Webinterface Icinga Web2 sowie zusätzliche Datenbankkonnektoren und eine REST-API. Die erste stabile Version 1.0 von Icinga wurde im Dezember 2009 veröffentlicht.

Aufgrund seiner direkten "Abstammung" von Nagios verfügt Icinga über ähnliche Grundfunktionen bei der Überwachung verschiedener IT-Infrastrukturkomponenten, Alarmfunktionen und entsprechende Überwachungseinstellungen. Allerdings gibt es auch einige Unterschiede.

Nagios vs. Icinga: ein Vergleich

Wie bereits erwähnt, lag ein Schwerpunkt bei der Entwicklung von Icinga auf der Weiterentwicklung der webbasierten Benutzeroberfläche. Die Icinga-Web-Oberfläche Icinga Web2 wird von Anwendern als moderner und benutzerfreundlicher als Nagios bewertet. Icinga Web2 zeichnet sich insbesondere durch sein ansprechendes Design und seine Benutzerfreundlichkeit aus und bietet eine intuitive Benutzererfahrung bei der Überwachung und Verwaltung der Infrastruktur.

Bei der Entwicklung der Icinga-Benutzeroberfläche wurde besonderes Augenmerk auf die grafische Darstellung gelegt. Icinga bietet integrierte Unterstützung für grafische Dashboards und Visualisierungsfunktionen, die den Benutzern anpassbare Ansichten und Diagramme zur Überwachung des Status und der Leistung ihrer Infrastruktur bieten. Um grafische Dashboards in Nagios zu erstellen, können zusätzliche Plugins oder externe Tools erforderlich sein.

Es gibt auch Unterschiede zwischen Nagios und Icinga, wenn es um die Konfiguration geht: Nagios verwendet traditionell ein "Flat File"-Konfigurationsformat, das vor allem in größeren IT-Umgebungen sehr komplex und zeitaufwändig sein kann. Icinga hingegen hat ein verbessertes Konfigurationsformat, das übersichtlicher und modularer ist. Darüber hinaus verfolgt Icinga einen vorlagenbasierten Konfigurationsansatz. Es ist einfacher, die

definieren Sie wiederverwendbare Konfigurationsvorlagen für Hosts und Services. Dies vereinfacht die Konfigurationsverwaltung und verbessert die Skalierbarkeit.

Im Vergleich zu Icinga (2009) ist Nagios jedoch bereits seit zehn Jahren auf dem Markt. Die erste Version wurde am 14. März 1999 vorgestellt. Dies hat zwangsläufig einen Einfluss auf die Größe des Ökosystems und der Community, die Dokumentation und zusätzliche Ressourcen.

Nagios hat eine viel größere Auswahl an zusätzlichen Plugins, aber Icinga ist vollständig kompatibel mit allen Nagios-Plugins. Icinga-Benutzer können daher die bestehende Nagios-Plugin-Bibliothek nutzen.

IT-Infrastrukturüberwachung mit Open-Source-Tools - die wichtigsten Kriterien

Wenn ein Unternehmen den Einsatz eines Open-Source-Tools für die Überwachung der IT-Infrastruktur in Erwägung zieht, sollte der erste Schritt darin bestehen, die organisatorischen Anforderungen für den Einsatz eines solchen Tools zu prüfen.

Organisatorische Voraussetzungen für den Einsatz von Open-Source-Überwachungstools

Dies beginnt mit dem technischen Know-how im Unternehmen selbst. Der Einsatz von Open-Source-Tools für das IT-Infrastruktur-Monitoring setzt in der Regel entsprechende Open-Source-Expertise im Unternehmen voraus. Bei kommerzieller Software bietet der Softwareanbieter in der Regel entsprechenden Support an - entweder direkt oder über spezialisierte Implementierungspartner. Bei Open-Source-Software gibt es nur die öffentlich verfügbare Dokumentation und die Community. Das bedeutet, dass es im Unternehmen selbst Experten geben muss, die über die notwendigen Kenntnisse und Fähigkeiten verfügen, um die Überwachungslösung effektiv zu nutzen, zu konfigurieren, anzupassen und zu warten. Nur so kann sichergestellt werden, dass das Tool richtig implementiert und sein Potenzial voll ausgeschöpft wird.

Gerade im Hinblick auf die für ein bestimmtes Open-Source-Tool verfügbare Dokumentation ist es wichtig, im Vorfeld zu klären, wie umfangreich diese ist. Es muss sichergestellt werden, dass die Dokumentation umfassend, aktuell und für die IT leicht zugänglich ist. Darüber hinaus sollten Unternehmen eine Schulung ihrer Mitarbeiter in Betracht ziehen, damit diese das gewählte Tool effizient nutzen und verwalten können.

Das Gleiche gilt für die Community: Open-Source-Tools leben von der Unterstützung und den Beiträgen der Community. Unternehmen sollten prüfen, wie groß und aktiv die Gemeinschaft rund um das gewählte Tool ist. Eine aktive Gemeinschaft gewährleistet eine kontinuierliche Entwicklung, Fehlerbehebungen und Zugang zu einer Fülle von Wissen, Foren und Ressourcen für Support und Hilfe.

Eine weitere wichtige Voraussetzung für den erfolgreichen Einsatz eines Open-Source-Tools für die IT-Infrastrukturüberwachung ist die Frage der Integration in bestehende Systeme. Es muss sichergestellt werden, dass das Tool nahtlos in andere IT-Infrastrukturkomponenten wie IT-Ticketsysteme, Konfigurationsmanagementsysteme oder Berichtsplattformen integriert werden kann.

Schließlich sollte auch die Skalierbarkeit und Leistung des Open-Source-Überwachungstools geklärt werden. Ist das Tool in der Lage, mit den wachsenden Anforderungen der IT-Infrastruktur mitzuwachsen? Wie wirkt sich dieses Wachstum auf die Leistung und die Fähigkeit aus, immer größere Mengen von Überwachungsdaten zu verarbeiten? Ist das Tool in der Lage, geografisch verteilte IT-Umgebungen zu überwachen? All diese Fragen sollten im Vorfeld geklärt werden, bevor die Auswahl eines geeigneten Tools in Betracht gezogen wird.

Gesamtkostenbetrachtung: Open Source ist (nicht) immer die günstigere Option

Ein wichtiger Aspekt bei der Überlegung, ob ein Open-Source-Tool verwendet werden soll, sind natürlich die Kosten. Auf den ersten Blick schneidet Open-Source-Software besser ab als kommerziell vertriebene Software, da sie in der Regel kostenlos angeboten wird. Der Preisunterschied kann jedoch beträchtlich sein, insbesondere für große Unternehmen, die viele Softwarelizenzen benötigen.

Auf den zweiten Blick reicht es aber natürlich nicht aus, sich nur auf die Anschaffungs- oder Lizenzkosten zu konzentrieren. Vielmehr ist eine Gesamtkostenanalyse erforderlich, die auch die folgenden Kostenblöcke berücksichtigt.

Anpassung und Integration: Open-Source-Software bietet im Allgemeinen die Flexibilität, die Software an unternehmensspezifische Bedürfnisse anzupassen und zu verändern. Dies ist theoretisch ein Vorteil gegenüber kommerzieller Software, die in diesem Bereich oft engere Grenzen hat. Allerdings müssen diese Anpassungen und Änderungen auch von jemandem durchgeführt, überwacht und ggf. überarbeitet werden, was zusätzlichen Aufwand verursacht und damit

zusätzliche Kosten.

Unterstützung und Wartung: Kommerzielle Software umfasst oft Support- und Wartungsleistungen des Anbieters, die entweder in den Lizenzkosten enthalten sind oder zusätzlich in Anspruch genommen werden können. Im Gegensatz dazu kann man bei Open-Source-Software auf den Support durch die Community zurückgreifen. Dennoch werden Support- und Wartungskapazitäten auch unternehmensintern benötigt, was mit entsprechenden Kosten verbunden ist.

Upgrades und Aktualisierungen: Auch bei diesem Kostenpunkt schlägt das Pendel auf den ersten Blick zu Gunsten von Open-Source-Lösungen aus. Kommerzielle Softwareanbieter veröffentlichen in der Regel regelmäßige Updates und neue Versionen, die mit Kosten für die Aktualisierung von Lizenzen oder Wartungsverträgen verbunden sind. Open-Source-Software hingegen bietet Updates und Upgrades ohne direkte Kosten. Die Kehrseite der Medaille ist, dass die Unternehmen, die diese Open-Source-Lösungen einsetzen, Zeit und Ressourcen - und damit Geld - in die Verwaltung von Updates und die Gewährleistung der Kompatibilität mit anderen Komponenten der IT-Infrastruktur investieren müssen.

Schlussfolgerung: Wie so oft im Leben hängt der Kostenvergleich zwischen kommerzieller Software und Open-Source-Lösungen immer vom Einzelfall ab. Wichtig ist an dieser Stelle der Hinweis, dass ein reiner Vergleich der Anschaffungskosten nicht ausreicht, sondern immer ein Gesamtkostenvergleich erstellt werden muss. Erst dann wird sich zeigen, ob Open-Source-Software tatsächlich die günstigere Alternative ist.

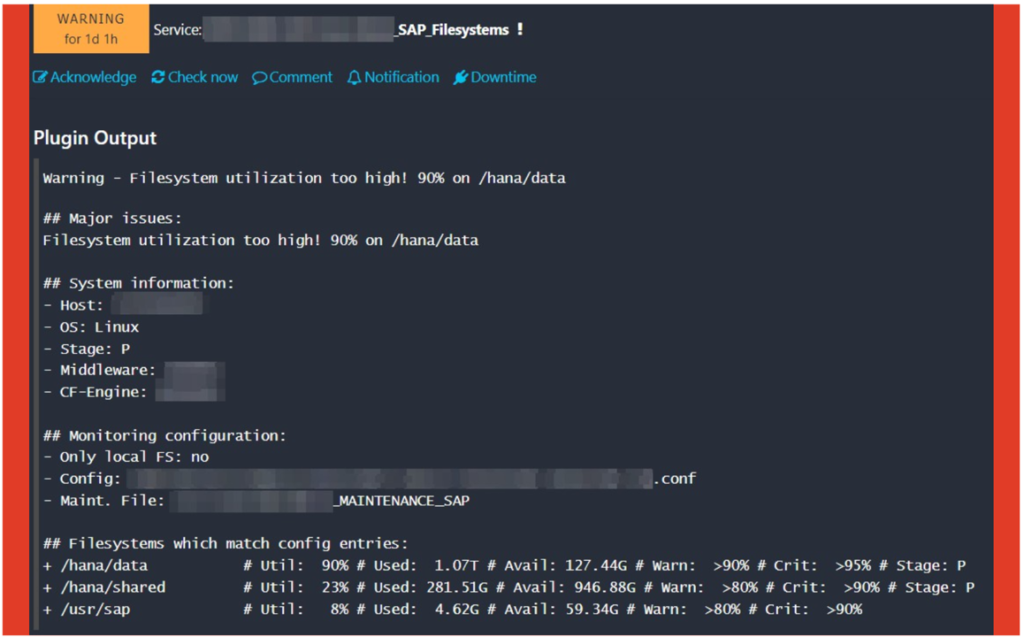

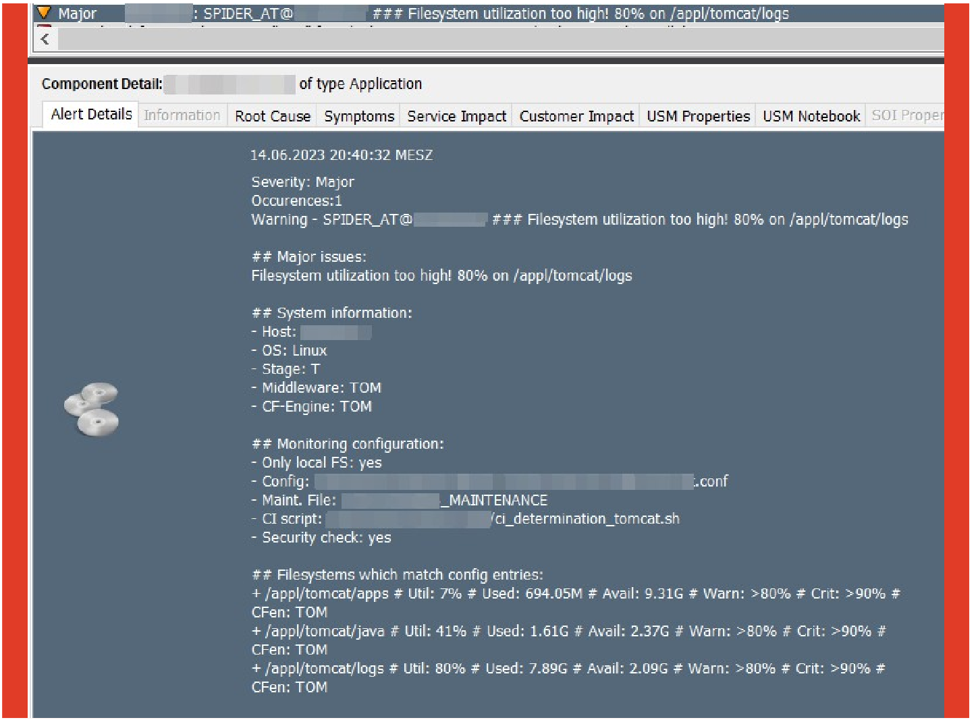

Beispiel 2: Erweiterung der Icinga-Anbindung an CA SOI für dynamische Alarmtitel

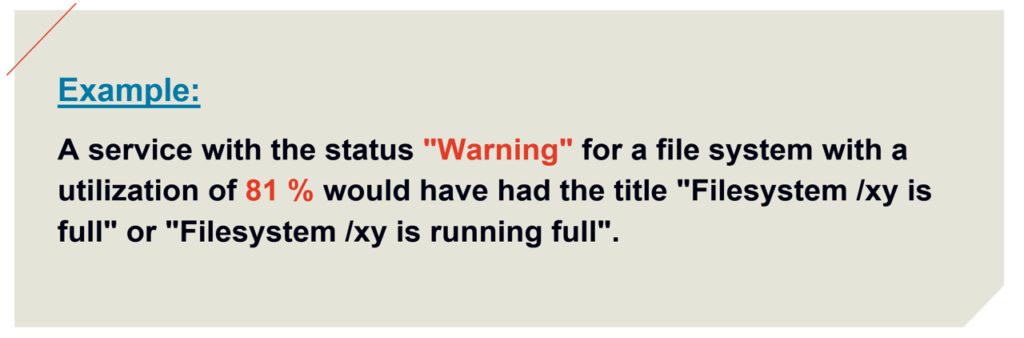

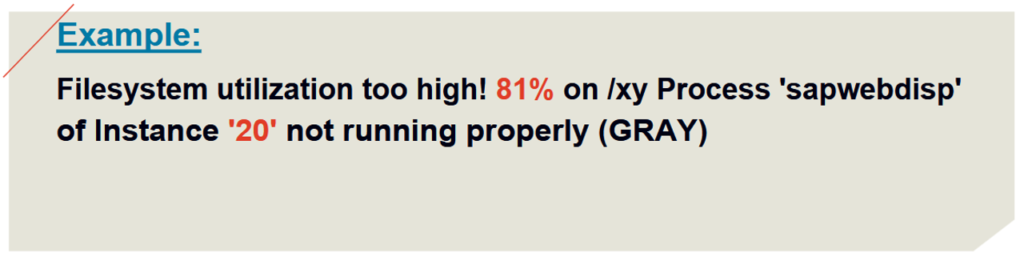

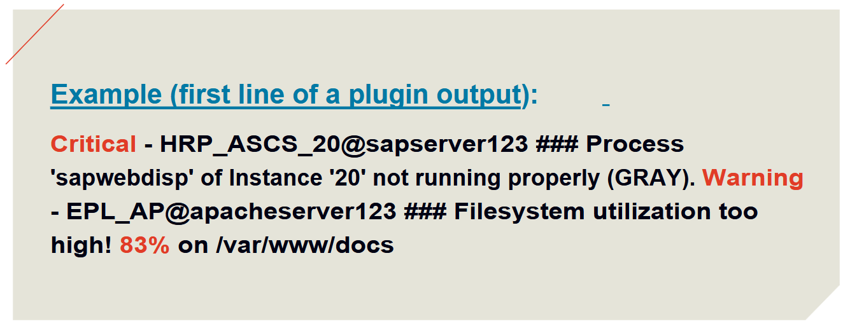

Ursprünglich konnten Alarmmeldungen von Icinga an CA SOI nur eine feste Zeichenfolge als Alarmtitel oder Alarmzusammenfassung enthalten, die dann als Vorfallstitel verwendet wird. Dieser Titel war fest - unabhängig von der Priorität des Alarms - und erwies sich daher manchmal als nicht aussagekräftig genug.

amasol hat das Optimierungspotenzial erkannt, wenn die aktuellen Messwerte auch über die Ausgabe der Icinga-Plugins in den Alarmtitel übertragen werden. Dies ist jedoch nicht für jeden Icinga-Dienst möglich, da die Ausgabe einiger Plugins nicht den Anforderungen eines Alarmtitels entspricht. Die von amasol entwickelten Plugins sind jedoch alle darauf ausgelegt, eine detaillierte und nützliche Ausgabe zu liefern, die sich als Alarm- und Ereignistitel eignet.

amasol entwickelte daraufhin einen Schalter im Icinga-Service (und damit für jeden Service individuell konfigurierbar) zur Umschaltung der Titelanzeige. Nach wie vor wird ein fester und vordefinierter Alarmtitel an CA SOI oder die erste Zeile der Plugin-Ausgabe gesendet.

Ein erweitertes Benachrichtigungsskript verwendet die erste Zeile der Plugin-Ausgabe, wenn der Schalter aktiviert ist, und entfernt die Statusinformationen ("Warnung: ", "WARNUNG - ", "Kritisch: ", ...). Die bereinigte "Ereignismeldung" wird dann an die Alarmkonsole als Alarmtitel gesendet.

Bei allen von amasol entwickelten Plugins ist es möglich, diese Option zu aktivieren und so - wenn vom Kunden gewünscht - immer hilfreiche und präzise Alarmtitel zu übermitteln.

Beispiel 3: Erweiterung der Verbindung von Icinga zu CA SOI für variable CIs

Ursprünglich wurden Alarmmeldungen mit festen, im Icinga-Dienst konfigurierten CIs an SOI gesendet. Dieses Konstrukt ist jedoch für verschiedene Anwendungen zu starr. Zum Beispiel hat bei der grundlegenden Überwachung von Webservern jeder Webserver auf jedem Server sein eigenes CI. Es müsste also für jeden Webserver auf jedem Server ein eigener Icinga-Service eingerichtet werden. Ein weiteres Beispiel ist die SAP-Überwachung: Jede SAP-Komponente hat ihr eigenes CI, aber aufgrund der Komplexität der SAP-Umgebung wäre es nicht möglich, jede SAP-Komponente auf einem Server einzeln über einen entsprechenden Dienst zu überwachen - und zwar für jeden SAP-Server.

Die erforderliche Flexibilität wird dadurch erreicht, dass das CI durch das Monitoring-Plugin auf dem Server ermittelt und als CI in der Benachrichtigung gesendet wird.

Für solche Spezialfälle entwickelt amasol Icinga-Plugins, die das CI auf dem jeweiligen Host ermitteln und in der Plugin-Ausgabe in einem vordefinierten Format ausgeben.

Darüber hinaus wurden das Benachrichtigungsskript und der Icinga-Service um einen weiteren Schalter erweitert, um zusätzlich das CI aus der Plugin-Ausgabe zu lesen und anstelle des im Service definierten CIs an CA SOI zu senden.

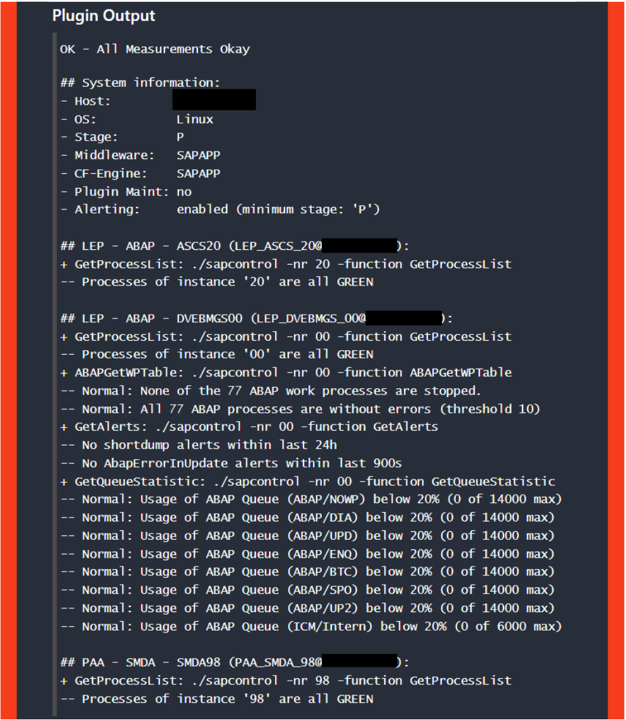

Benutzerdefinierte Plugins (basierend auf einem eigenen Framework für bash-basierte Plugins)

Wie eingangs erwähnt, hat amasol eine ganze Reihe von eigenen Plugins für Icinga entwickelt, die auf Linux, AIX, HP-UX und SunOS laufen. Die Plugin-Ausgabe all dieser Plugins wurde mit System-/Metainformationen angereichert.

Alle Plugins können über Flag-Dateien in den "Wartungsmodus" versetzt werden (weiterhin aktive Überwachung, aber deaktivierte Alarmierung/Benachrichtigung). Zusätzlich können Alarmmeldungen über einen Schalter für niedrige Stufen (z.B. Stufe "Test") deaktiviert werden. Dies ist unabhängig davon möglich, wo der Dienst läuft: Das Plugin kümmert sich darum.

Die Plugins sind "cluster-aware", d.h. es erfolgt keine Alarmierung bei inaktiven Clusterknoten.

Zusätzlich werden aufgerufene Programme (z.B. df) überwacht und hängende Prozesse (mit Ausnahme von Prozessen, die über sudo gestartet wurden) nach Erreichen eines konfigurierbaren Timeouts "getötet". Dies stellt sicher, dass der Timeout der Icinga-Dienste keine Prozesse (Waisen) auf dem System zurücklässt und dem System nach einer bestimmten Zeit seine Ressourcen entzieht. Es werden Informationen über hängende Prozesse bereitgestellt, die über sudo gestartet wurden.

Beispiele

• SAP-Plugin (über 4.000 Zeilen)

• konfigurationsbasiertes Dateisystemüberwachungs-Plugin (nur Dateisysteme, die tatsächlich auf dem Server vorhanden sind, werden anhand von Schwellenwerten und Filterkriterien (wie Stage- und Meta-Flags) aus der Konfiguration überwacht)

• ulimit Überwachung (nproc und nofile) für bestimmte Benutzer

• Überwachung von Herzschrittmacher-Clustern

Wie das Praxisbeispiel zeigt, bietet der Einsatz von Open-Source-Tools für das IT-Infrastruktur-Monitoring Vorteile in Bezug auf Flexibilität und Offenheit bei der Anpassung und Weiterentwicklung.

Diese Vorteile können jedoch nur dann genutzt werden, wenn die notwendigen Kompetenzen und Kapazitäten vorhanden sind - mit entsprechenden Auswirkungen auf Kosten und Budgetbedarf.

Praktisches Beispiel: Einsatz von Icinga zur Überwachung der IT-Infrastruktur in der Automobilindustrie

Das folgende Praxisbeispiel veranschaulicht die Ausgangssituation und die Gründe, die ein großes internationales Unternehmen der Automobilindustrie dazu veranlasst haben, Icinga als Werkzeug zur Überwachung der IT-Infrastruktur einzusetzen. Es werden auch die mit dieser Entscheidung verbundenen Auswirkungen betrachtet.

Ausgangslage: Kosten und Schatten-IT

Im Jahr 2017 beschloss das Unternehmen, eine bis dahin für die Überwachung der IT-Infrastruktur verwendete kommerzielle Softwarelösung durch das Open-Source-Tool Icinga zu ersetzen. Das entsprechende Migrationsprojekt wurde dann zu Beginn des folgenden Jahres gestartet.

Neben der strategischen Entscheidung innerhalb des Konzerns, stärker auf den Open-Source-Ansatz zu setzen, war einer der Hauptgründe für den Wechsel die Kosten: Erklärtes Ziel war es, die Lizenzkosten in diesem Bereich deutlich zu senken und von der unterschiedlichen Bewertung der Kosten (Lizenzkosten für kommerzielle Software = CAPEX, Wartungs- und Betriebskosten für Open-Source-Software = OPEX) zu profitieren.

Ein zweiter wichtiger Aspekt für die Entscheidung: Schatten-IT. Unter diesem Begriff versteht man die Nutzung von IT-Lösungen (insbesondere Software) außerhalb der offiziellen Kontrolle und Verantwortung der IT-Abteilung eines Unternehmens. Einzelne Mitarbeiter, aber auch ganze Abteilungen, nutzen IT-Lösungen, ohne dass diese von der IT-Abteilung genehmigt und in den Überwachungsprozess eingebunden sind. Die IT-Abteilung ist oft nicht einmal über die Nutzung dieser Lösungen informiert.

Lösungen.

Open-Source-Lösungen sind geradezu prädestiniert für die Schatten-IT, weil sie kostenlos verfügbar sind und nur heruntergeladen und installiert werden müssen.

Im Fall des Unternehmens aus der Automobilindustrie war zumindest bekannt, dass insbesondere Nagios ein beliebtes Tool in der Schatten-IT ist. Mit der offiziellen Einführung von Icinga sollten die über das Unternehmensnetzwerk verteilten Schatten-IT-Anwender "zurückerobert" und davon überzeugt werden, dass, wenn sie schon ein Open-Source-Tool für das IT-Infrastruktur-Monitoring einsetzen, dies zumindest eine mit der IT abgestimmte Lösung ist.

Letztlich ging es darum, die Tool-Landschaft für das IT-Infrastrukturmanagement zu standardisieren.

Herausforderungen und Lösungen

Die weitere Verwendung von Icinga zeigte jedoch, dass die Qualität der Überwachungsergebnisse weit hinter den Erwartungen zurückblieb und nur durch zahlreiche Optimierungen und Erweiterungen der in den öffentlichen Repositories verfügbaren Icinga-Plugins verbessert werden konnte. Darüber hinaus mussten eigene Plugins entwickelt werden. Dabei wurde das Unternehmen von den Icinga-Experten von amasol unterstützt.

Beispiel 1: Icinga-Agenten auf Linux-Servern

In der Praxis tritt das Problem der "hängenden" Icinga-Agenten auf Linux-Servern immer wieder auf. Die betroffenen Agenten zu identifizieren und neu zu starten, war bisher recht komplex und zeitaufwändig. Ein von amasol entwickeltes Skript

• identifiziert die entsprechenden Agenten über die CLI-Befehlskonsole von Icinga2,

• ermittelt den entsprechenden Servernamen und

• startet die Agenten über SSH neu

All dies geschieht ohne jegliche Benutzerinteraktion, da das Skript täglich automatisch per Cronjob (dem Linux-Scheduler) gestartet wird und sich dann um die Neustarts der Agenten kümmert. Dabei werden auch unterschiedliche Netzwerkzonen berücksichtigt und für die SSH-Verbindung werden Jump-Server verwendet.

Ergebnis: Die Betriebszeit der Icinga-Agenten wird erhöht, ohne dass sich jemand manuell darum kümmern muss.

Bewährte Verfahren für den Einsatz von Open-Source-Tools für die Überwachung der IT-Infrastruktur

Die folgenden Best Practices sollen eine Hilfestellung für den Einsatz von Open-Source-Tools zur Überwachung der IT-Infrastruktur bieten.

Bewertung der aktuellen IT-Infrastruktur

Bevor man überhaupt über die Wahl eines Tools nachdenkt, ist eine Bewertung der aktuellen IT-Infrastruktur des Unternehmens ein entscheidender erster Schritt:

Bestandsaufnahme der IT-Infrastruktur: Eine Bestandsaufnahme der IT-Infrastruktur gibt einen Überblick über den Umfang und die Komplexität der vorhandenen IT-Infrastruktur und beantwortet die Frage, welche Komponenten der IT-Infrastruktur in das System integriert werden sollen.

Überwachung.

Anforderungen an Leistung und Verfügbarkeit: Die kritischen Leistungs- und Verfügbarkeitsanforderungen an die Infrastruktur werden ermittelt. Faktoren wie Antwortzeiten, erforderliche Betriebszeit, Durchsatz und Schwellenwerte für die Ressourcennutzung müssen berücksichtigt werden. Diese Bewertung hilft bei der Festlegung der erforderlichen Überwachungskennzahlen und -schwellenwerte, um sicherzustellen, dass die IT-Infrastruktur den Anforderungen des Unternehmens entspricht.

Derzeitige Überwachungseinrichtung: Anschließend sollte eine Bewertung der vorhandenen Überwachungsinstrumente, -prozesse und -abläufe vorgenommen werden. Dadurch werden mögliche Lücken oder Einschränkungen in der aktuellen Überwachungseinrichtung aufgedeckt, wie z. B. mangelnde Sichtbarkeit bestimmter Komponenten oder unzureichende Warnfunktionen. Diese Bewertung gibt Aufschluss darüber, in welchen Bereichen Open-Source-Überwachungstools die bestehenden Überwachungsfunktionen ergänzen oder verbessern können.

Datenquellen und Integrationsschnittstellen: Anschließend müssen die zu überwachenden Datenquellen und Integrationsschnittstellen innerhalb der Infrastruktur ermittelt werden. Dazu gehört auch die Definition der Arten von Protokollen, Leistungsmetriken und Ereignissen, die für die Überwachung wichtig sind. Die Kenntnis der Datenquellen hilft bei der Bewertung der Kompatibilität von Open-Source-Tools und stellt sicher, dass die erforderlichen Überwachungsdaten effektiv gesammelt und analysiert werden können.

Skalierbarkeit und zukünftiges Wachstum: Welche Anforderungen werden an die Skalierbarkeit der Infrastruktur gestellt? Diese Bewertung hilft dabei, die Skalierbarkeit von Open-Source-Tools zu beurteilen und sicherzustellen, dass sie den aktuellen und zukünftigen Überwachungsanforderungen entsprechen.

Festlegung von Überwachungszielen und Entwicklung einer wirksamen Überwachungsstrategie

Der nächste Schritt ist die Festlegung von Überwachungszielen und einer Überwachungsstrategie. Die Überwachungsziele dienen als Grundlage für die Überwachungsstrategie. Es ist wichtig zu verstehen, worum es bei der Überwachung gehen soll. Mögliche Ziele könnten sein

• Sicherstellung einer hohen Verfügbarkeit der IT-Infrastruktur

• Erkennen von Leistungsengpässen

• Überwachung des allgemeinen Systemstatus

• Einhaltung der gesetzlichen Anforderungen und Vorschriften

• Compliance mit Service Level Management

• Etc.

Nach der Festlegung der Überwachungsziele ist der nächste Schritt die Festlegung der Überwachungsstrategie. Die folgenden Themen sollten dabei berücksichtigt werden:

• Bestimmung der kritischen IT-Infrastrukturkomponenten, die in die Überwachung einbezogen werden müssen.

• Definition der für die Überwachung der IT-Infrastruktur relevanten KPIs und Metriken

• Festlegung der Schwellenwerte und Alarme für die definierten Messgrößen

• Erstellung einer Überwachungsarchitektur (Skalierbarkeit, Netztopologie, Datenerfassungsmethoden, IT-Sicherheitsanforderungen usw.) und Definition der erforderlichen Überwachungsinstrumente, Agenten, Sensoren usw.

• Implementierung eines Überwachungs-Dashboards für einen Echtzeit-Überblick über die Leistung und den Status der IT-Infrastruktur

• Festlegung der Prozesse und Arbeitsabläufe für die Bearbeitung von Alarmen und kritischen Vorfällen (Eskalationsverfahren, Rollen und Verantwortlichkeiten)

Auswahl des/der geeigneten Tools, Implementierung, Anpassung und Konfiguration

Sobald die Überwachungsziele und die Überwachungsstrategie festgelegt sind, besteht der nächste Schritt in der Auswahl des/der geeigneten Tools. Wie die Beispiele Nagios und Icinga zeigen, kommt es bei Open-Source-Tools vor allem auf Faktoren wie Funktionalität, Skalierbarkeit, Community-Support und Dokumentation an. Auch die Kompatibilität mit den IT-Infrastrukturkomponenten und anderen im Unternehmen eingesetzten IT-Infrastrukturmanagementsystemen muss geprüft werden.

Die nächsten Schritte sind die Planung und Durchführung der Implementierung, Konfiguration und Anpassung. Dabei ist es wichtig, die notwendigen Kapazitäten und das Know-how im Unternehmen zu haben, da man sich - anders als bei kommerzieller Software - nicht auf den Herstellersupport verlassen kann.

Regelmäßige Wartung und Aktualisierung

Das gilt natürlich auch für Wartungsarbeiten und Updates. Bei Open-Source-Monitoring-Tools ist es wichtig, sich über die neuesten Versionen, Updates und Sicherheitspatches auf dem Laufenden zu halten. Diese müssen aber auch zeitnah installiert werden.

Es ist auch sinnvoll, sich aktiv an der Community für das Open-Source-Tool zu beteiligen: Foren, Newsletter und Online-Diskussionen sind wichtige Informationsquellen und bieten die Möglichkeit, Tipps und Hinweise zu geben, Erfahrungen auszutauschen und zur Weiterentwicklung des Tools beizutragen. Dieses Engagement kommt letztlich der gesamten Community zugute.

Schlussfolgerung und Empfehlungen

Open-Source-Tools für die Überwachung von IT-Infrastrukturen wie Nagios und Icinga haben sich mittlerweile als Alternative zu kommerziellen Softwarelösungen etabliert. Unsere Erfahrungen im praktischen Einsatz haben jedoch zwei wesentliche Einschränkungen aufgezeigt:

Zusammenfassung und Konsolidierung von Vorfällen

Bei der Verwendung von Open-Source-Tools für die IT-Infrastrukturüberwachung kann die Aggregation und Konsolidierung von Vorfällen eine einschränkende Rolle spielen. Hierfür gibt es verschiedene Gründe:

Datenquellen und -formate: Open-Source-Tools können Daten aus einer Vielzahl von Quellen sammeln, die in unterschiedlichen Formaten verfügbar sind. Die Integration und Konsolidierung dieser Datenquellen kann eine Herausforderung darstellen, insbesondere wenn sie nicht standardisiert sind. Das Ergebnis ist eine fragmentierte Ansicht von Vorfällen und eine fehlende Aggregation als Grundlage für einen vollständigen Überblick über die IT-Infrastruktur.

Die Komplexität der Umwelt: In großen IT-Infrastrukturen kann es viele verschiedene Komponenten und Systeme geben, die überwacht werden müssen. Jede dieser Komponenten kann potenziell Vorfälle erzeugen. Das Erkennen von Korrelationen zwischen verschiedenen Vorfällen und das Zusammenführen ähnlicher Vorfälle kann schwierig sein, insbesondere wenn die Open-Source-Tools nicht über integrierte Mechanismen für eine intelligente Datenkorrelation verfügen.

Mangel an Intelligenz und Automatisierung: Einige Open-Source-Tools bieten möglicherweise nicht die Automatisierungs- und Intelligenzfunktionen, die für eine effektive Zusammenfassung und Konsolidierung von Vorfällen erforderlich sind. AIOps-Plattformen, die auf proprietären Lösungen basieren, können dagegen fortschrittliche Analysen und Korrelationsalgorithmen nutzen, um Vorfälle zu gruppieren, zu priorisieren und automatische Wiederherstellungsmaßnahmen zu ergreifen.

Fehlende Überwachung der Nutzererfahrung

Das Fehlen einer Überwachung der Benutzererfahrung kann auch eine einschränkende Rolle bei der Verwendung von Open-Source-Tools für die Überwachung der IT-Infrastruktur spielen. Die Überwachung der Benutzererfahrung bezieht sich auf die Überwachung der Leistung und Reaktionsfähigkeit einer Anwendung aus der Perspektive des Endbenutzers. Es ermöglicht die Erfassung von Metriken wie Ladezeiten, Antwortzeiten, Verfügbarkeit und Fehlermeldungen zur Qualität der Benutzererfahrung.

Open-Source-Tools konzentrieren sich häufig auf die Überwachung von Infrastrukturkomponenten wie Servern, Netzwerken und Datenbanken. Diese Tools bieten unter Umständen keine direkte Möglichkeit, das tatsächliche Nutzererlebnis zu erfassen. Ohne diese Perspektive wird es jedoch schwierig, die Auswirkungen von Infrastrukturproblemen auf das Benutzererlebnis zu verstehen und zu beheben. Zusätzlich zur Überwachung der Infrastruktur ist es sinnvoll, eine ergänzende Überwachung der Benutzererfahrung einzurichten, idealerweise in Form einer Kombination aus synthetischer Überwachung der Benutzererfahrung (Simulation von Benutzertransaktionen) und realer Überwachung der Benutzererfahrung (Beobachtung von "echten" Benutzertransaktionen zur Leistungsbewertung). Diese Sichten können in eine zentrale Eventkonsole oder - mit automatisierter Ursachenanalyse - in ein AIOps-Umgebungssystem integriert werden.

Mehr entdecken

Schenker setzt bei User Experience Monitoring und Application Performance Management im Bereich Luft- und Seefracht auf Dynatrace und amasol

Die umfassende Unterstützung von Dynatrace für moderne Cloud-, On-Premise- und Hybrid-Umgebungen stellt zudem Skalierbarkeit und langfristige Anpassungsfähigkeit sicher. Das Ergebnis ist eine zuverlässigere, kosteneffizientere und einfacher zu verwaltende Observability-Lösung im Vergleich zu fragmentierten Systemen oder weniger integrierten Ansätzen.

Dynatrace & amasol: Stronger together

85 % der Technologieführer beobachten: die zahlreichen Tools, Plattformen, Dashboards und Applikationen machen Ihr Multicloud-Environment immer komplexer.

amasol vereinfacht den Betrieb von Multicloud-Environments, verbessert die Leistung und schafft - dank unserer ganzheitlichen Lösung - einen nahtlosen Geschäftsbetrieb.

Dynatrace & amasol: Stronger together

Dynatrace bietet wertvolle Einblicke in Ihre IT-Prozesse. amasol nutzt diese Informationen und verbindet sie mit Ihren Geschäftsprozessen.

Sie haben sich erfolgreich für unsere Exeon Workbench registriert.

Guten Tag,

vielen Dank für Ihre Anmeldung zur Workbench | Bedrohungserkennung mit KI-basierter Verhaltensanalyse.

Hier sind die wichtigsten Informationen:

Wann: Dienstag, 30. September 2025 | 10:00 - 11:00 Uhr

Wo: Online via Zoom

Wir freuen uns auf Ihre Teilnahme und auf interessante Diskussionen und Präsentationen rund um das Thema Detectability.

Mit freundlichen Grüßen

Laura Ilgner

Eine Woche vor der Veranstaltung erhalten Sie von uns eine Erinnerungsmail.

Erfolgreiche Anmeldung bei der DX NetOps Usergroup in Wien

Guten Tag,

vielen Dank für Ihre Anmeldung zu der DX NetOps Usergroup von amasol.

Hier sind die wichtigsten Informationen:

Wann: Donnerstag, 09. Oktober 2025 | 9:45 - 17:00 Uhr

Wo: im MEZZANIN Meetings & Events by Zeitgeist Vienna nahe Wiener Hauptbahnhof

Hier finden Sie Informationen zur Lage und Anfahrt.

Wir freuen uns auf Ihre Teilnahme und auf interessante Diskussionen und Präsentationen rund um das Thema Broadcom.

Mit freundlichen Grüßen

Laura Ilgner

Eine Woche vor der Veranstaltung erhalten Sie von uns eine Erinnerungsmail.

Lorem ipsum dolor sit amet, consectetur adipiscing elit. Ut elit tellus, luctus nec ullamcorper mattis, pulvinar dapibus leo.